_

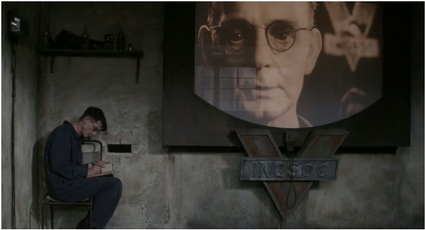

1984 es una película basada en la novela de

George Orwell publicada en 1949, del mismo nombre.

El director fue Michael Radford y el protagonista es John Hurt.

Se trata de una obra de ciencia ficción y fantasía,

para una profunda reflexión de los efectos

y límites del poder autoritario.

Los gigantes estadunidenses Google (Alphabet), Apple, Amazon, Facebook, Microsoft y los chinos Baidu, Alibaba, Tencent y Xiaomi se integran en “negocios estratégicos” basados en datos y algoritmos, con las corporaciones Bioquímicas, Bioinformáticas y/o Bioingeniería.

Los nuevos descubrimientos (investigaciones privadas) científicos y desarrollos tecnológicos representan un reto mucho más profundo para el ideal básico de la democracia liberal: la libertad humana.

El liberalismo (en su concepción europea) defiende la libertad humana porque asume que las personas son únicas, distintos a todos los demás animales de la vida terrenal. La diferencia es que el humano, en teoría, tiene libre albedrío. Eso es lo que hace que los sentimientos y las decisiones humanas constituyan la máxima autoridad moral y política en el mundo.

El mito del libre albedrio tiene poca relación con lo que la ciencia nos dice de los humanos y otros animales. Los seres humanos, sin duda, tienen voluntad, pero no son libres. No podemos decidir qué deseos tenemos. No decidimos, por ejemplo, ser introvertido o extrovertido, tranquilo o inquieto.

Los seres humanos tomamos decisiones, pero nunca son decisiones independientes. Cada una de ellas depende de condiciones biológicas y sociales que escapan a nuestro control. Podemos decidir qué comer, con quién casarnos y a quién votar para presidente, pero esas decisiones dependen de mi bioquímica, mi sexo, mi origen familiar, mi cultura nacional, mi condición económica etc.; todos ellos, elementos que no elegimos.

Estas reflexiones son fáciles de observar. Fíjese en la próxima idea que surge en tu cerebro. ¿De dónde ha salido? ¿Se le ha ocurrido libremente? ¿Alguna vez te pasó que, la noche anterior a un acontecimiento importante, intentas dormir, pero no lo logras, una serie constante de pensamientos y preocupaciones te lo impiden? Si podemos escoger libremente, ¿por qué no podemos detener esa corriente de pensamientos y relajarnos?

El mito del libre albedrío fue útil en el pasado. Infundió valor a quienes lucharon contra la Inquisición, el derecho divino de los reyes, el Ku Klux Klan y gobiernos autoritarios.

En 1776 y en 1939 no era muy grave creer que nuestras convicciones y decisiones eran producto del libre albedrío, y no de que podían estar orientados por la bioquímica y la neurología. Porque en 1776 y en 1939 nadie entendía muy bien la bioquímica, ni la neurología. Ahora, sin embargo, tener fe en el libre albedrío es peligroso.

La decisión y los algoritmos

Para conseguir “piratear” a los seres humanos, hacen falta tres cosas: sólidos conocimientos de biología, miles y millones de datos, redes de comunicación con gran capacidad de transferencia y una gran capacidad de cómputo y almacenamiento informático. Nunca antes, se tuvo condiciones para penetrar en los seres humanos porque se carecía de conocimientos sobre biología, del tremendo arsenal de tecnologías en informática y comunicaciones TIC. Ahora, en cambio, es posible. Tanto las corporaciones digitales como los Gobiernos cuentan con todos estos recursos TIC; cuando logren hackear el sistema operativo humano no solo podrán predecir nuestras decisiones, sino también manipular nuestros sentimientos. Algunas de estas configuraciones ya las conocemos como el Neuromarketing.

En el territorio digital, navegar por internet es la forma de realizar recorridos por las diferentes zonas web del mundo digital. Mientras alguien navega por Internet y le llama la atención un titular: “El riego de un dólar a $180 da pánico”. Pica (acción de activar el Click del mouse) en el titular. Al mismo tiempo, su vecina también está navegando por la Red y ve un titular diferente: “Trump prepara un ataque nuclear contra Irán”. Pica en el titular, ambos se disponen a leerlos.

Los dos titulares pueden ser noticias falsas, quizá generadas por troles, o por un sitio web deseoso de captar más tráfico para mejorar sus ingresos por publicidad o por solo el hecho de crear climas políticos de riego para la población. Tanto la primera persona como su vecina creen que han accedido a esos titulares por su libre albedrío. Pero, en realidad, las han hackeado.

Cuando Hitler pronunciaba un discurso en la radio, apuntaba al mínimo común denominador porque no podía construir un mensaje a medida de cada oyente, no podía personalizarlo. Ahora sí es posible hacerlo. Ahora no solamente se personaliza el mensaje, sino que se conoce los sentimientos de los destinatarios.

Un algoritmo puede decir o predecir si alguien ya está predispuesto contra los inmigrantes, y si su vecina ya detesta a Trump, de tal forma que el primero ve un titular y la segunda, en cambio, otro completamente distinto. Algunas de las mentes más brillantes del mundo llevan años investigando cómo piratear el cerebro humano para hacer cliquear en determinados anuncios y así vendernos cosas. ¿Trump y Bolsonaro habrían ganado las elecciones sin Facebook?

El valor político del flujo de datos permanente de esta plataforma digital, fue visible en el 2013 cuando la Agencia de Seguridad Nacional de USA reconoció la utilización de Facebook para el seguimiento de ciudadanos que aportaban sus datos “inocentemente”, información que durante años había sido un objetivo de los trabajos de inteligencia.

El mejor método es hacer click en los botones del miedo, el odio o la codicia que llevamos dentro los humanos. Y ese método ha empezado a utilizarse ahora para vendernos hechos políticos e ideologías y candidatos electorales.

Por ahora, se limitan a analizar la trazabilidad de las señales “las migas digitales” externas: los productos que compramos, los sitios web que visitamos, las palabras que buscamos y los texto o podcast que habitan internet.

La implementación creciente de la Internet de las Cosas (IoT) permite que sensores digitales conectados a equipamientos, lugares, dispositivos de uso personal, transporte, etc. recopilen información local y la transfieran a un sitio en internet o a una nube informática. En este sentido, los sensores biométricos podrían proporcionar acceso directo a nuestra realidad interior y saber qué sucede en nuestro órgano que regula nuestra frecuencia cardíaca. Acceder al músculo que bombea y regula nuestra presión sanguínea y gran parte de nuestra actividad cerebral. ¿Es posible entonces, correlacionar el ritmo cardiaco con los datos de la tarjeta de crédito y la presión sanguínea con el historial de búsquedas? ¿De qué habrían sido capaces la Inquisición y el nazismo con unas pulseras biométricas que vigilen constantemente nuestro ánimo y nuestros afectos?

El liberalismo democrático ha desarrollado un impresionante arsenal de argumentos e instituciones para defender las libertades individuales contra ataques externos de Gobiernos represores y religiones intolerantes, ¿pero está preparado para una situación en la que la libertad individual se socava desde dentro? ¿Los conceptos “libertad” e “individual” tienen el mismo sentido que en la época siguiente a la revolución francesa?

En los sistemas de información se “piratean” datos a través de líneas de código (software) defectuosas preexistentes. Estos códigos se representan mediante software (programas) que se ejecutan en computadoras. El sistema de información de los seres humanos, contiene miedos, odios, prejuicios y deseos preexistentes. Los piratas no pueden crear miedo ni odio sin esta condición preexistente. Pero, cuando descubren, mediante la ciencia de datos, lo que una persona ya teme y odia, tienen acceso fácil para activar las emociones correspondientes y provocar una furia aún mayor, es decir activan el código defectuoso del bio software que se ejecuta en los humanos.

El los sistemas computacionales para los códigos maliciosos que ponen en riego nuestros datos se han desarrollado antivirus que permite preservar nuestra información del software malicioso. ¿Quién desarrollará un antivirus para el sistema operativo humano?, ¿cuáles son las garantías de salud ciudadana que garantizará la privacidad de los datos? ¿Cómo se asume esta responsabilidad, desde el Estado o desde las corporaciones? ¿Cómo funciona la democracia en la era de la digitalización de la vida cotidiana, una era en la que es posible hackear los sistemas operativos de los seres humanos? ¿Dónde quedan afirmaciones como que “el votante sabe lo que conviene” y “el cliente siempre tiene razón”?

Muchas preguntas que nos incomodan a los humanos, necesarias ya que es mejor considerarlas en el contexto actual donde el reto de la inteligencia artificial y la bioingeniería avanzan motorizadas por las corporaciones dueñas de los algoritmos y las infraestructuras tecnológicas por donde viajan los datos necesarios para conocer el sistema operativo humano.

Las democracias tal como las conocemos, tienen el gran desafío político de encontrar las respuestas, de pensar y debatir un modelo político que aproxime el respeto por las libertades humanas en el colectivo que las habita.

Algoritmos y Datos

Utilizar algoritmos que monitoreen la salud 24 hs los 7 días de la semana mediante sensores biométricos podría descubrir y alertar, mediante la ciencia de datos, un cáncer cuando es apenas un puñado de células que comienzan a dividirse y proliferar. Estas posibilidades reales, son fáciles, económicas e indoloras; anticipan la instancia de un tratamiento que dos años más tarde, de no haberlo previsto, es un gran problema. También podrían ser agentes inteligentes que extraen datos para luego aplicar un big data cuyo resultado le permita a las empresas de seguros médicos garantizar sus finanzas.

Los algoritmos Machine-Learning (ML), están llamados a revolucionar la práctica clínica en los próximos años, desde el diagnóstico hasta la prevención y el tratamiento mejorando la cuantificación del riesgo.

El algoritmo EN-PESA, desarrollado por el Centro Nacional de Investigaciones Cardiovasculares (CNIC) de España, es capaz de personalizar el riesgo cardiovascular de personas sanos, en función de su edad, tensión arterial, dieta y marcadores medibles en análisis de sangre y orina.

EN-PESA, podría servir como una herramienta económica y fácil para calcular el grado de aterosclerosis subclínica, es decir, la cantidad de grasa depositada en las paredes de las arterias, especialmente para las personas con un mayor riesgo. Contribuye a personalizar el riesgo lo que se traduce en tratamientos y seguimiento personalizados.

EN-PESA utiliza un modelo de aprendizaje máquina llamado Elastic Net que permite utilizar de manera no sesgada un número alto de variables, lo que posibilita la identificación de nuevos predictores más allá de los factores de riesgo tradicionales, señala Fátima Sánchez Cabo, jefa de la Unidad de Bioinformática del CNIC.

Otra aplicación con ML muestra que frente a un texto de COVID-19, el cerebro espera encontrar vocablos como pandemia o virus y, cuando se topa con ellos, acelera la lectura, según señalan estudios sobre predicción de la palabra.

Un grupo de investigación de la Universidad de Buenos Aires de Argentina estudió por primera vez, bajo esta mirada, cuentos largos en español, en un experimento del que participaron 2.500 personas. El equipo también busca modelar computacionalmente este mecanismo que el cerebro humano realiza de manera magistral y automática. “Por primera vez, estudiamos el efecto de leer palabras más o menos predecibles en textos largos en español. En general, todas las investigaciones se hacen en párrafos cortos u oraciones, especialmente diseñadas para los experimentos, en idioma inglés o chino”, destaca Bruno Bianchi, del Instituto de Ciencias de la Computación de la Facultad de Ciencias Exactas y Naturales de la UBA y primer autor de un trabajo publicado en Scientific Reports de Nature Research sobre predictibilidad.

En el contexto descripto privado y público es necesario adoptar medidas en el plano político y normativo a efectos de maximizar los beneficios y minimizar los posibles riesgos, garantizar la propiedad y soberanía de los datos de los ciudadanos.

Los proveedores de servicios que comercializan sistemas “inteligentes” digitales y plataformas de almacenamiento de datos son proveedores comerciales.

No existen regulaciones normalizadas que rijan la propiedad de los datos generados y recopilados por los sensores de IoT y la tecnología de uso en el sector Salud. Es necesario asegurar al paciente ciudadano la propiedad y soberanía sobre los mismos.

Los gobiernos de la región deben garantizar seguridad al posible uso inadecuado de los datos por el proveedor de servicios digitales, como el uso de los datos por terceros (a menudo la validación de los datos y la mejora del algoritmo). Esto requerirá una política nacional y regional para elaboración de un marco normativo. Además, la propiedad de los datos tiene que debatirse y reglamentarse más en relación con la promoción y uso de datos de libre acceso y la mitigación de las inquietudes en materia de seguridad.

Con la digitalización de la vida cotidiana, los datos se transforman cada vez más en un bien económico, y con ello su valor aumenta. En consecuencia, la soberanía sobre los mismos, puede definirse como el control que ejercen países y personas físicas-jurídicas sobre sus datos, se convierte en un desafío que requiere más reglamentación y una vigilancia efectiva.

Las TIC, la Bioinformática, la Nanotecnología, la Bioingeniería no deberían incorporase en nuestros países sin regulaciones políticas que cuiden el bien común y el derecho y bienestar de las comunidades. Estamos asistiendo a una realidad global. Estas multinacionales tecnológicas y monopólicas descuidan el bien común y los derechos de los trabajadores en beneficio propio. ¿Contar con información pública sobre el comportamiento de los algoritmos y los datos de entrenamiento puede ser esa herramienta?

Una cuestión es la tecnología y los beneficios que podemos obtener y otra cuestión es el entorno político en el que se introducen estas tecnologías. Los ingenieros y científicos que participamos de estas configuraciones debemos asumir la politización de nuestra práctica laboral ya que sus efectos en la sociedad y la vida humana son determinantes.

No somos responsables de las decisiones corporativas, pero seremos responsables del silencio aprendido en la cultura del “emprendedor”. Somos Ciudadanos que ejercemos un conocimiento y una práctica laboral de profundo impacto en el territorio digital.

Los algoritmos guían nuestras preferencias y atan nuestras elecciones. Vuelven realidad el sueño liberal de la elección sin ataduras, pero este sueño esconde también su contracara: una libertad algorítmicamente pautada.